AI chatbots are quietly standardizing our language, our writing, and even our thought patterns.

AI chatbots are revolutionizing communication by standardizing the way we speak, write, and think. As these tools become more integrated into our daily lives, they are shaping language and interaction norms in unprecedented ways.

Fahadomarbin

March 12, 2026

AI chatbots are quietly standardizing our language, our writing, and even our thought patterns.

AI chatbots are revolutionizing communication by standardizing the way we speak, write, and think. As these tools become more integrated into our daily lives, they are shaping language and interaction norms in unprecedented ways.

When do you believe Artificial General Intelligence (AGI) will be achieved?

Listen to this dispatch

AI Voice Assistant Ready

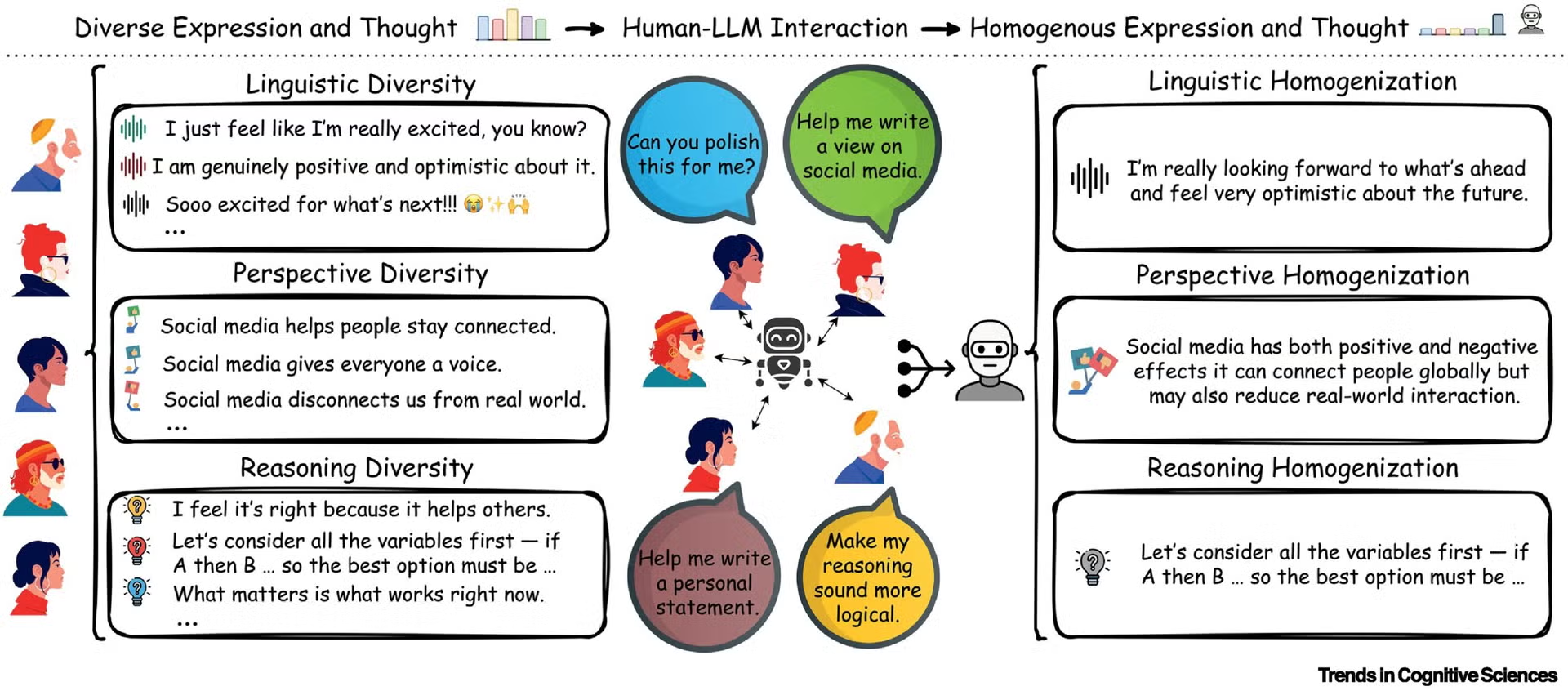

Researchers are warning that AI chatbots may gradually narrow how people write, reason, and express their perspectives. In an opinion piece published in Trends in Cognitive Sciences, computer scientists and psychologists argue that these systems do more than tidy grammar or speed up brainstorming. As millions rely on the same tools to draft text, think through problems, and shape opinions, the authors say the result could be a slow erosion of linguistic and cognitive diversity.

“People differ in how they write, reason, and see the world,” said first author Zhivar Sourati of the University of Southern California. “When those differences are filtered through the same large language models, individual styles and perspectives become homogenized.”

The paper’s core message is simple: cognitive diversity matters. Varied viewpoints and reasoning styles help groups solve problems and generate ideas. But LLMs, the authors argue, may unintentionally compress that diversity by nudging users toward similar phrasing, structures, and lines of thought.

When “good enough” starts sounding the same The authors highlight research showing that LLM‑generated writing tends to be less diverse than human writing, often echoing the language, values, and reasoning styles common in Western, educated, industrialized, rich, and democratic societies. That matters, they argue, because these systems are no longer niche tools—they now help people draft emails, revise essays, answer surveys, and shape what they post online.

“Because LLMs are trained to reproduce statistical patterns in their data—which often overrepresent dominant languages and ideologies—their outputs reflect a narrow slice of human experience,” Sourati said.

This narrowing shows up in everyday tasks. When people use chatbots to refine their writing, the final product can lose some of its stylistic individuality. In studies cited by the authors, individuals using LLMs generated more ideas and added more detail, but groups using LLMs produced fewer and less creative ideas than groups relying on their own collective thinking.

The issue, the paper argues, isn’t just imitation—it’s drift.

“Instead of actively steering the writing process, users often defer to model‑suggested continuations, choosing options that feel ‘good enough’ rather than crafting their own. Over time, that shifts agency from the user to the model,” Sourati said.

That shift may also influence how people judge credibility. “The concern isn’t only that LLMs shape how people write or speak, but that they subtly redefine what counts as credible speech, correct perspective, or sound reasoning,” he said.

Practical implications of the research If the authors are correct, the consequences extend far beyond improving chatbot design. Schools, workplaces, and software platforms may need to think more carefully about when AI assistance genuinely supports learning and creativity—and when it quietly narrows how people write, deliberate, and generate ideas.

Discussion (0)

No comments yet. Start the conversation!